Table of Contents

Gastbeitrag von Yervant Kulbashian (): „Der grüne Schwan – Teil 3: Eine dünne Schicht von Symbolen“

| Original text click here: |

Einleitung

Der hier erschiene Gastbeitrag stammt von Yervant Kulbashian, den ich über Social Media kennen und schätzen gelernt habe.

Yervant arbeitet als Engineering Manager bei einer KI-Plattform für die kanadische Firma „Kindred“, die zur „Ocado-Group“ gehört. Nur zur Information:

„Kindred wurde 2014 gegründet und ist ein Unternehmen für Robotik und künstliche Intelligenz (KI), das Roboter zur Lösung von Problemen in der realen Welt entwickelt. Das Unternehmen hat es sich zur Aufgabe gemacht, das Leben menschlicher Arbeitskräfte mit der Leistung von KI-Robotern zu verbessern. Die Spitzentechnologie von Kindred bildet die Grundlage für eine Reihe von proprietären Plattformen, darunter CORE mit AutoGrasp™, die für den autonomen Betrieb von Robotern in dynamischen Umgebungen entwickelt wurden. Das Team aus Wissenschaftlern, Ingenieuren und Geschäftsleuten hat einen neuen Standard für das Reinforcement Learning von Robotern gesetzt. Das Unternehmen hat seinen Sitz in San Francisco und Toronto und gehört zur britischen Ocado Group plc.“ (https://www.apollo.io/people/Yervant/Kulbashian/54a916287468693399953e0c).

Und genau dieses Reinforcement Learning als „autonomer Betrieb von Robotern in dynamischen Umgebungen“ war der Auslöser zur einer sehr produktiven Korrespondenz zu meinem zuvor veröffentlichten Essay „Das System braucht neue Strukturen – nicht nur für/gegen die Künstliche Intelligenz (KI)„. Der Schwerpunkt unseres interessanten Austausches, den wir später auch in unserer „Zoomposium-Tafelrunde“ fortgesetzt haben, lag hauptsächlich auf dem „Subjekt-Objekt-Konzept“ für „maschinelles Bewusstsein“ und den Möglichkeiten einer symbolischen Repräsentation oder Implementation von menschlicher Sprache auf Maschinen und den hierbei auftretenden logischen Problemen.

In diesem Zusammenhang hatte Yervant bereits im September 2022 seine Artikel zur Sprach-Implementation auf Maschinen veröffentlicht, die im Zusammenhang mit ChatGPT und den Möglichkeiten zur Implementation oder Repräsentation von menschlicher Sprache allerdings eine ganz neue Perspektive und Aktualität erhalten. Die Essays zeigen aber auch sehr deutlich, dass ChatBots momentan noch nichts anderes sind als sehr kluge, „sprechende Papageien„, aber noch sehr weit von semantischen Konzepten der Sprache, geschweige denn bewussten Verwendung, entfernt sind.

Yervant hat sich freundlicherweise bereit erklärt seine 3 Artikel zu dieser Thematik auch bei mir zu veröffentlichen, die ich nun sukzessive online stelle. Um sie meiner deutschen Leserschaft zugänglich zu machen, habe ich sie ins Deutsche übersetzt. Der Originaltext ist aber unten zur Verfügung gestellt.

Dieser 3. Teil seines Gesamt-Essays beschäftigt hauptsächlich mit der Problematik, wie das sprachgeleitete, menschliche Denken „von dieser impliziten Stufe zu einer formalen Logik entwickelt werden kann“. Hierbei müssen Sie zunächst „die Stufen der Konzeptualisierung oder Abstraktion durchlaufen“ werden, um hieraus in einem weiteren Schritt „die Begriffe für logische Konzepte“ für Maschinen zu entwickeln, zu erlernen und auf mehrere ähnliche Beispiele anwenden zu können. Also für Maschinen bleibt hier noch viel zu „erlernen“ ;-).

Der Originaltext steht aber auf meiner Seite unten zur Verfügung.

Zu dem weiterführenden Thema „AC/DC“ (nur als bonmot gemeint 😉 oder „Artificial Consciousness/Digital Consciousness„ sind allerdings noch weitere Projekte geplant, auf die ich hier schon einmal prospektiv hinweisen möchte. Aber jetzt soll Yervant oder besser gesagt „die KI zur Sprache kommen“:

Übersetzung: „Der grüne Schwan- Teil 3: Eine dünne Schicht von Symbolen“

Lesen Sie Teil 1 und Teil 2 der Serie.

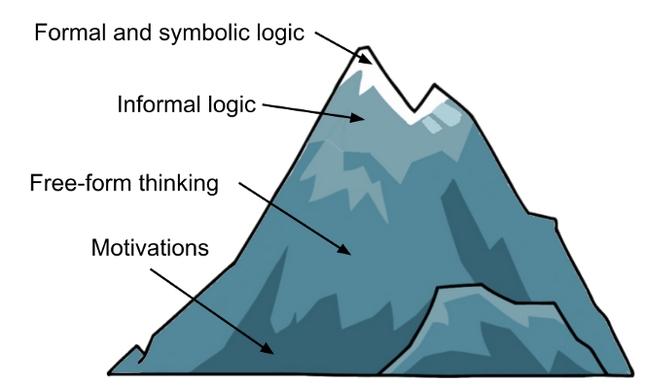

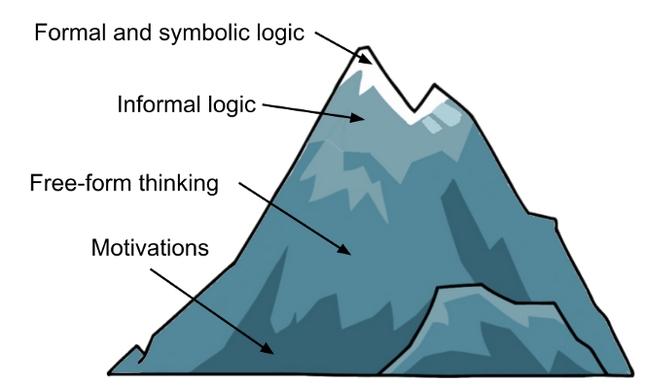

Schauen wir uns endlich die formale Logik an: die abstrakten Regeln, Symbole und Operationen, mit denen die meisten von uns erst nach der Schule vertraut werden – wenn überhaupt.

Wenn Sie Logik verwenden, tun Sie das in der Regel informell, als konkrete Reaktion auf die aktuelle Situation. Wenn ein Freund Ihnen sagt, er habe den ganzen Tag Kopfschmerzen gehabt, dann wissen Sie, dass Sie ihn nicht fragen sollten, ob er einen guten Tag hatte. Man könnte dies als „praktische“ oder „implizite“ Logik bezeichnen, da sie nicht auf einer formalisierten Regel beruht. Sie bestätigen, dass sie gültig war, wenn sie Sie vor Peinlichkeiten bewahrt. Dies ist vergleichbar mit Ihrem alltäglichen Verständnis von Moral: Sie wissen vielleicht von Fall zu Fall ungefähr, was unmoralisch ist und was nicht, ohne eine übergreifende Theorie der Moral zu haben.

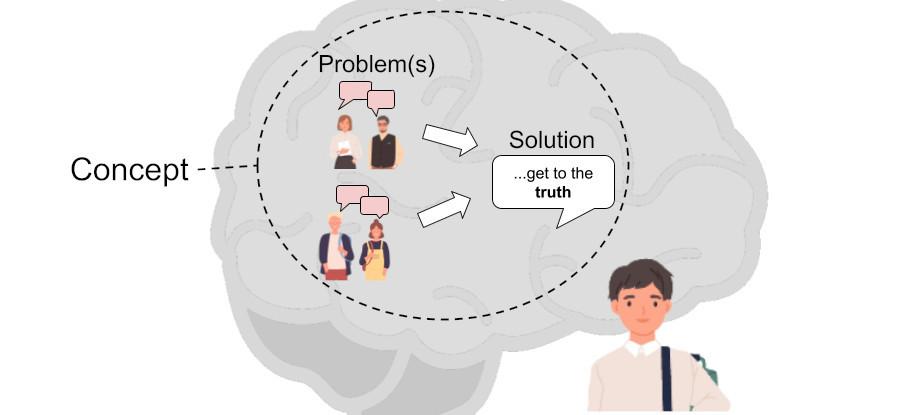

Um Ihr Denken von dieser impliziten Stufe zur formalen Logik zu entwickeln, müssen Sie zunächst eine Stufe der Konzeptualisierung oder Abstraktion durchlaufen. In dieser Phase entwickelt man Begriffe für logische Konzepte und lernt, wie man sie auf mehrere ähnliche Beispiele anwenden kann.

Dieser Schritt stellt uns übrigens vor die vielleicht interessanteste und schwierigste Herausforderung in der gesamten KI, nämlich „wie entstehen abstrakte Konzepte in einem Geist?“ Logische Konzepte wie „vollständig“, „falsch“, „gültig“, „entgegengesetzt“, „Wahrheit“ usw. wurden bisher als „gegeben“ angenommen, und als solche sind sie implizit in jede KI eingebaut, die versucht, sie zu verwenden. Das liegt vor allem daran, dass es nicht in Frage kam, die KI diese Begriffe selbst ableiten zu lassen. Wie Sie weiter unten sehen werden, kann eine KI solche Konzepte tatsächlich von Grund auf neu erstellen, und zwar ausschließlich auf der Grundlage ihrer Motive und ihrer Zusammenarbeit mit anderen Menschen.

Wörter als Konzepte

Wenn ein Säugling das Wort „Mama“ sagt, will er damit nicht nur seine Mutter identifizieren oder beschreiben. Vielmehr möchte es Hilfe, Aufmerksamkeit oder Interaktion. Es kann die Abkürzung für „Schau mal, was ich gemacht habe!“ sein. Später überträgt es das Wort vielleicht auf andere Erwachsene und sogar auf Gegenstände, wenn es dadurch Aufmerksamkeit erhält. Genauso ist jedes Wort, das Sie verwenden, ein Werkzeug: Sie lernen es erst, wenn Sie entdecken, dass es zur Lösung eines Problems beiträgt.

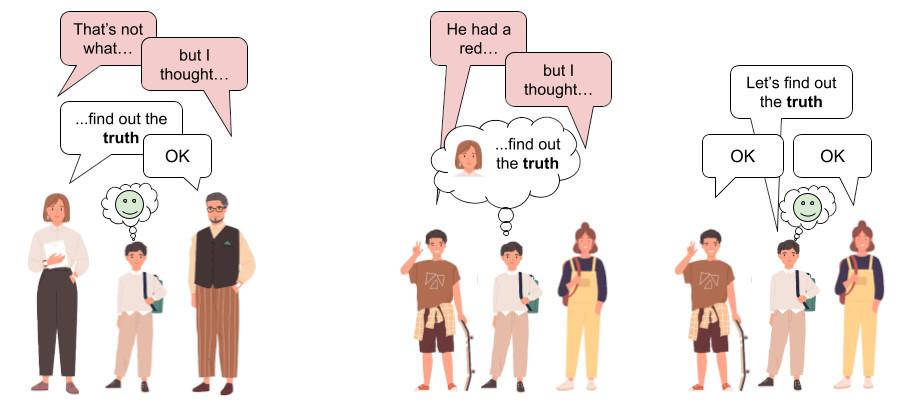

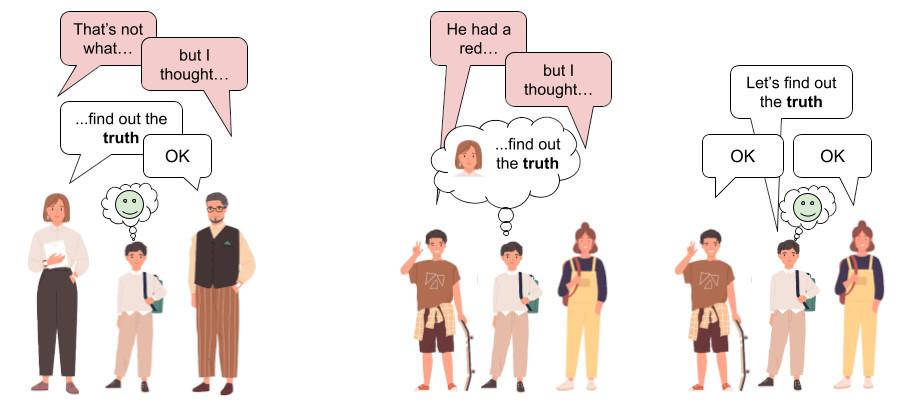

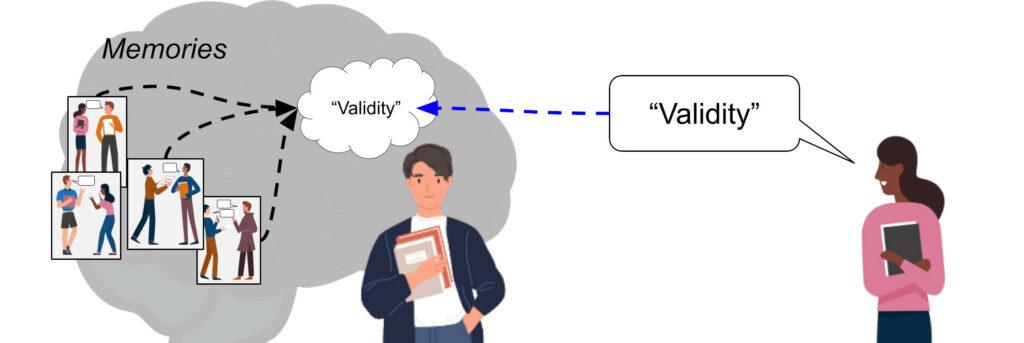

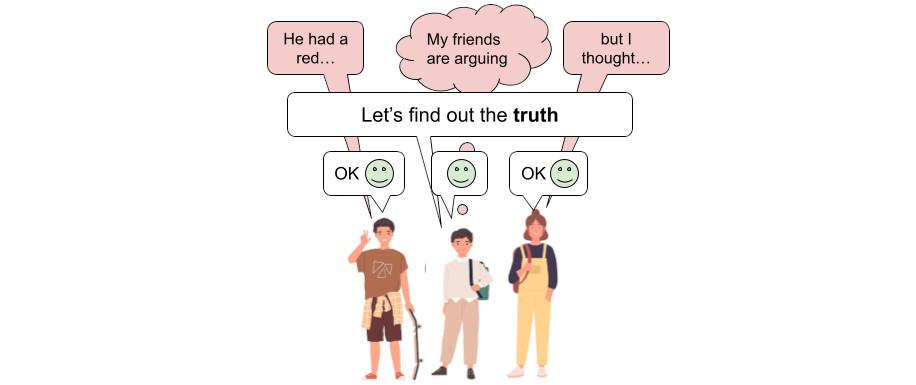

Nehmen wir das Wort „Wahrheit“. Sie können seinen Ursprung in Ihrem Geist auf den Wunsch zurückführen, Debatten zu schlichten oder Zweifel bei Menschen, die Ihnen etwas bedeuten, zu zerstreuen. Wenn Sie beispielsweise als Kind Zeuge eines angespannten Hin und Her zwischen Familienmitgliedern wurden, die sich über ein unsicheres Thema uneinig waren, hörten Sie vielleicht, wie jemand sagte, er solle die „Wahrheit“ über das Thema herausfinden. Dieses Wort schien den Ton des Gesprächs zu ändern und die Spannung in der Luft zu lindern, auch wenn Sie nicht wussten, warum. Für Sie hätten die Worte genauso gut „hört auf zu diskutieren“ oder „beruhigt euch“ bedeuten können.

Später kam es zu einer weiteren Diskussion, diesmal zwischen Ihren Freunden, und damit auch zu einer neuen Spannung. Irgendwann sprach einer Ihrer Freunde in einem Ton oder erwähnte etwas, das Sie an den ersten Konflikt erinnerte, und die Worte „finde die Wahrheit heraus“ kamen Ihnen in den Sinn. Also hast du sie laut ausgesprochen, in der Hoffnung, dass sie sich dadurch „beruhigen“ würden.

Später kam es zu einer weiteren Auseinandersetzung, diesmal zwischen Ihren Freunden, und damit zu einer neuen Spannung. Irgendwann sprach einer Ihrer Freunde in einem Tonfall oder erwähnte etwas, das Sie an den ersten Konflikt erinnerte, und die Worte „finde die Wahrheit heraus“ kamen Ihnen in den Sinn. Also haben Sie sie laut ausgesprochen, in der Hoffnung, dass sie sich dadurch „beruhigen“ würden.

Da Ihre Freunde zwar etwas älter, aber immer noch jung und beeinflussbar waren, vertrauten sie auf die kulturelle Autorität, die man ihnen mit den Worten „die Wahrheit“ eingeimpft hatte. Wie zuvor schien dieser Satz also die Spannung zu lindern. Ihr Verstand übertrug nun den Satz und er wurde zu einer Antwort auf beide Situationen. In der Folge wurde er in ähnlichen Situationen in Ihren Gedanken wachgerufen.

Noch hatten Sie kein tiefes Verständnis für die Bedeutung des Wortes oder seine Implikationen. Tatsächlich wäre Ihr erster Versuch, das Wort zu definieren, wahrscheinlich falsch gewesen1. Wie bei den meisten neuen Wörtern, die Sie im Gespräch aufgeschnappt haben, kannten Sie das Wort zunächst aufgrund seines Gefühls – dieses unaussprechlichen Zusammenhangs, in dem das Wort angemessen erscheint. Dieses Gefühl ist eigentlich eine Gestalt oder eine Zusammensetzung aus allen Problemkontexten, für die das Wort als Lösung gefunden wurde.

Sie haben vielleicht bemerkt, dass der hier beschriebene Prozess des Begriffslernens im Gegensatz zum populären „didaktischen“ Modell des Begriffserwerbs in umgekehrter Richtung verläuft. Sie haben nicht damit begonnen, die objektive Wörterbuchdefinition des Begriffs „Wahrheit“ zu lernen und diesen Begriff dann zur Lösung von Problemen zu verwenden. Vielmehr lernten Sie Methoden zur Lösung zwischenmenschlicher Probleme unter Verwendung des Wortes als einer Reihe von Lauten und arbeiteten dann allmählich an dieser anfänglichen Skizze durch Selbstreflexion und Dialektik, um ein immer feineres Bild von „Wahrheit“ zu schaffen. Kurz gesagt, zuerst hat man den Begriff gemacht, und erst später hat man ihn verstanden.2

Alle sprachlichen Konzepte beginnen ihr Leben auf diese Weise, als Lösungen für soziale Probleme. Dies ist das undefinierbare Band, das verschiedene und scheinbar unvereinbare Erfahrungen zu einer einzigen Abstraktion verbindet. Nehmen Sie einen beliebigen abstrakten Begriff und fragen Sie sich, was alle seine Beispiele gemeinsam haben. Dies sollte auch die Fälle einschließen, in denen das Wort als Metapher verwendet wird, z. B. das Wort „Fenster“, wie es in „die Augen sind die Fenster zur Seele“ verwendet wird. Sie werden feststellen, dass das einzige Bindeglied die Motivation ist, die Sie dazu gebracht hat, dieses Wort zu lernen.

So gesehen ist es nicht notwendig, einen eingebauten psychologischen Mechanismus anzunehmen, der die Schaffung von Konzepten oder sogar von Symbolen antreibt. Man muss nicht von der Existenz einer angeborenen neuronalen Struktur ausgehen, die automatisch ähnliche Beispiele unter einem gemeinsamen „Konzept“-Knoten zusammenfasst³. Der einfache Prozess der Auslösung von konditionierten Erinnerungen reicht aus, um beides zu emulieren.

Natürlich spielt die Ähnlichkeit noch eine Rolle. In dem obigen Beispiel gab es eine Ähnlichkeit in den beiden Debatten, die eine Erinnerung an das Wort „Wahrheit“ auslöste. Man könnte dies als einen Fall von „Lernen durch Assoziation“ betrachten. Die Ähnlichkeit reicht jedoch nicht aus; der Satz blieb in dem neuen Kontext hängen, weil er auch das Problem ansprach, um das es ging. Dies ist ein entscheidender und oft vernachlässigter Faktor in psychologischen Modellen, die erklären, wie Menschen Konzepte verallgemeinern. Der soziale Kontext, das Problem und der sprachliche Begriff spielen alle eine wichtige Rolle bei der Übertragung eines Wortes von einer Situation auf eine andere.

Ein Banner zum Sammeln

Im Laufe vieler solcher Erfahrungen haben Sie die gleichen Wörter mit immer mehr Situationen verbunden. Wie in Ihrer Kindheit waren auch in Ihrer Jugend soziale Motive die Triebfeder für das Lernen. Der Unterschied bestand nun darin, dass Sie es mit differenzierteren Situationen zu tun hatten, an denen reife Erwachsene beteiligt waren.

Die Wörter, die jetzt in Ihrem Kopf herumflogen, wirkten wie ein Klebstoff, mit dem Sie verschiedene und sonst nicht zusammenhängende Erfahrungen, einschließlich Erinnerungen, miteinander verbinden konnten. Wie Sie im zweiten Teil gesehen haben, macht es für den Verstand nur einen geringen Unterschied, ob eine Erfahrung in Gedanken oder in der Realität stattfindet. Dies führte zu einem Bootstrapping-Prozess, bei dem Sie Probleme nur mit Hilfe Ihrer Erinnerungen an Gespräche und deren Beziehungen zu wertgeladenen Wörtern lösten.

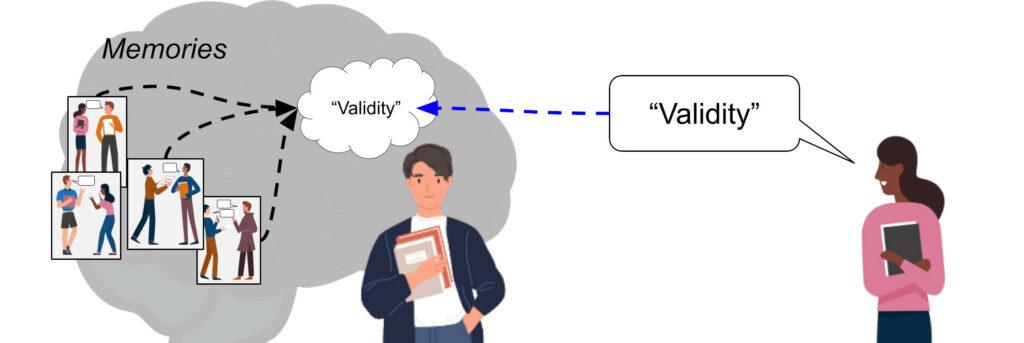

Ein Beispiel: Eines Tages, als Teenager, haben Sie vielleicht Trübsal geblasen und sich darüber geärgert, dass Ihnen ständig widersprochen wurde. Sie betrachten eine Erinnerung an eine schlechte Erfahrung. Sie fügen Erinnerungen an andere hinzu, in denen ähnliche Wörter oder Anblicke vorkommen, sowie Ihre Interpretationen dieser Erinnerungen. Dann hilft Ihnen ein Gleichaltriger mit ähnlichen Problemen, ein Wort zu finden, mit dem Sie Ihr Problem laut ausdrücken können: z. B. „Gültigkeit“.

Mit der Zeit haben Sie einen informellen logischen Wortschatz aufgebaut, den Sie in alltäglichen Gesprächen verwenden können. Ein Beispiel:

- Sie lernten das Wort „Konsens“: eine Möglichkeit, endlose Diskussionen zu vermeiden, die die Zeit aller Beteiligten vergeuden.

- Sie haben das Wort „Validität“ gelernt: eine Reihe von Verfahren, um eine Behauptung zu verteidigen, wenn andere Zweifel äußern.

- Sie haben das Wort „Konditional“ gelernt: die Möglichkeit, eine Behauptung neu zu justieren und zu spezifizieren, wenn man mit offensichtlich widerlegenden Fällen konfrontiert wird.

- Und Sie haben das Wort „Wahrheit“ gelernt: eine Möglichkeit, mit unseren gemeinsamen Zweifeln und Ungewissheiten umzugehen.

Ein großer Unterschied zwischen der Jugend und dem Säuglingsalter besteht jedoch darin, dass Sie inzwischen eine Theorie des Geistes entwickelt haben: die Fähigkeit, sich vorzustellen, was andere denken, und dadurch ihre Probleme nachzuvollziehen. Als Sie ein Kind waren, half es Ihnen lediglich, die „richtigen Worte“ zu sagen, um sich aus Schwierigkeiten herauszuwinden oder Erwachsene zu beeindrucken. Durch das neu erworbene Einfühlungsvermögen konnten Sie nun Wörter lernen, die Probleme nicht nur für Sie selbst, sondern auch für eine Gruppe von Menschen in Ihrer Umgebung lösten. Einem Problem einen Namen zu geben und ihn laut auszusprechen half, die Aufmerksamkeit der anderen auf die gemeinsame Schwierigkeit zu lenken. Der Akt des Lernens und Sprechens des Wortes selbst wurde so zu einer Art Lösung⁴.

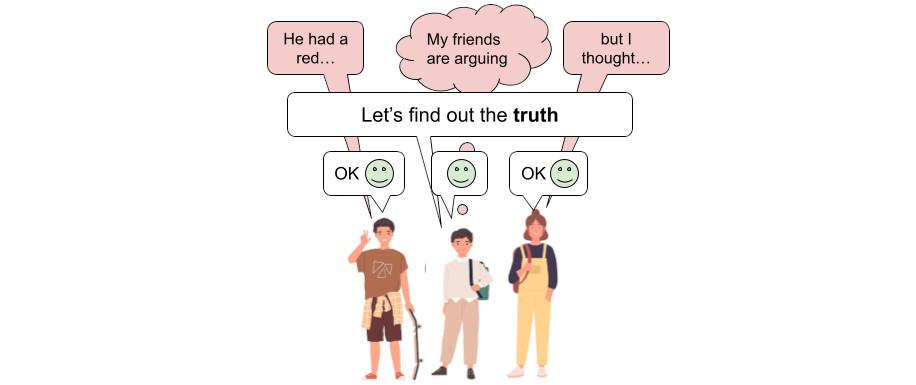

Das haben Sie oben mit dem Wort „Wahrheit“ getan: Es diente als Banner, um das sich Menschen, die ähnlich beunruhigt waren, versammelten, um ein zugrunde liegendes Problem zu lösen. Das gilt immer noch, auch wenn es für jeden von Ihnen andere Probleme gelöst haben mag. Das Wort war intersubjektiv geworden: Es ermöglichte anderen Menschen, an einem gemeinsamen Problem teilzuhaben und daran mitzuarbeiten.

Formalisierung

Intersubjektivität ist ein praktischer Trick, aber er beseitigt Missverständnisse nicht vollständig. Sie werden bald feststellen, dass Begriffe wie „Wahrheit“ oder „Inkonsistenz“ immer noch mehrdeutig sind. In Anbetracht der idiosynkratischen Erfahrungen Ihrer Freunde verbinden Sie mit dem Wort „Wahrheit“ andere Assoziationen oder Erfahrungen als Ihre Freunde – daher hat die Verwendung dieses Wortes nicht immer die beabsichtigte Wirkung.

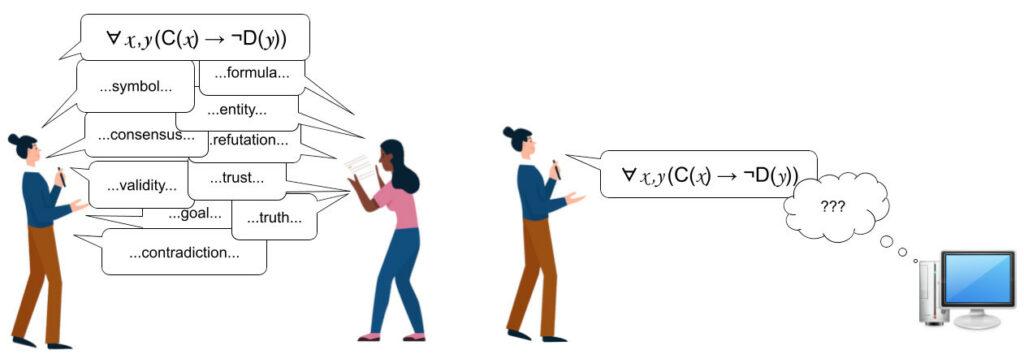

Wenn Sie immer noch von Missverständnissen frustriert sind, können Sie sich entscheiden, diesen Weg weiterzugehen und sich mit der formalen Logik zu beschäftigen. Die formale Logik ist ein Satz gemeinsamer, fester Schablonen, die Sie verwenden können, um die chaotischen Nuancen, die individuellen Abweichungen und die Subjektivität zu beseitigen, die alltägliche Unterhaltungen vereiteln können. Dies ist eine zweite Metaebene des Problemlösens. Das Problem ist nun die der Kommunikation innewohnende Mehrdeutigkeit. Die Wörter selbst sind zu einem Hindernis geworden, und zwar zu einem sozialen Hindernis.

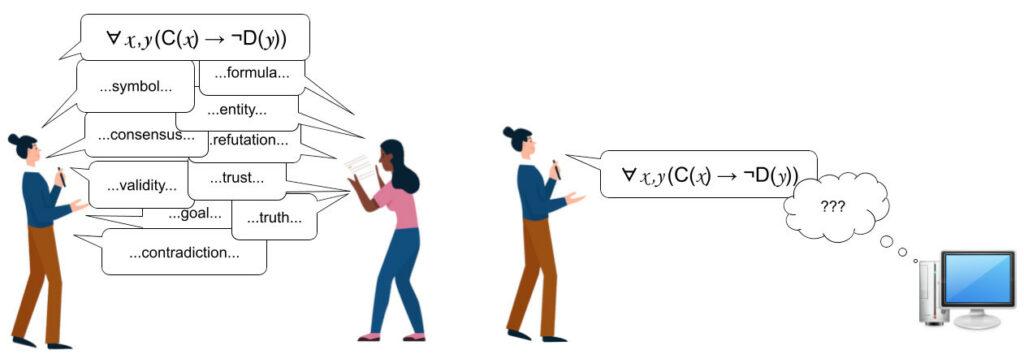

Wo informelle Wörter mehrere unvereinbare Interpretationen zulassen, macht die Formalisierung die gemeinsame Sprache konkret und beseitigt die Verwirrung, wenn man ein Thema mit anderen diskutiert. Gemeinsame Symbole wie „alle“ (∀) oder „nicht“ (¬) schaffen einen begrenzten Arbeitsbereich für die Klärung von Meinungsverschiedenheiten, um einen Konsens zu erreichen – zumindest ist das der Zweck dieser Symbole. In der Regel funktioniert dies nur in sehr engen Bereichen und nur so lange, wie man sich einig ist, was die Begriffe bedeuten und wie sie zusammenwirken.

Die Entwicklung eines solchen symbolischen Systems ist immer mit einem langen Kampf um gemeinsame Ideen, um Geben und Nehmen, um Missverständnisse und Klärung verbunden⁵. Die Geschichte der Logik des 20. Jahrhunderts, beginnend mit Freges Formalisierung und ihren Widerlegungen durch Quine und Dennett, ist ein lebendiges Zeugnis solchen Austauschs. Erst wenn alle Beteiligten in einem bestimmten Bereich – wie der Fuzzy-Logik oder der logischen Programmierung – zu einem vorläufigen Konsens gelangen, kristallisiert sich dieser in symbolischen Formeln und Gleichungen heraus. Das Gleiche gilt für jedes Fachgebiet, in dem Symbole verwendet werden, wie Mathematik oder Chemie. Symbole stellen die Apotheose des gegenseitigen Verständnisses dar.

Das Ziel für Sie oder jeden, der sich für das Studium der symbolischen Logik interessiert, ist es, das gesamte Gespräch in einen abstrahierten Raum gemeinsamer Symbole zu verlagern. „Abstraktion“ bedeutet hier nicht eine Reihe latenter oder verallgemeinerter mentaler Repräsentationen wie bei der künstlichen Intelligenz; es bedeutet einen angrenzenden Raum realer Wörter und Bilder, die Sie (und andere) als Reaktion auf die ursprünglichen Eingaben in Ihrem Geist hervorrufen. Sie werden „abstrakt“ genannt, weil sie sich nicht direkt auf die Bilder und Töne des eigentlichen Themas beziehen; Sie ersetzen diese durch eine andere Reihe allgemein verständlicher Symbole⁶.

Das Endergebnis ist starr, konkret und formelhaft. Es ist so konzipiert, dass die Menschen in so wichtigen Bereichen wie dem Ingenieurwesen klar kommunizieren können. Und sie kann diese Qualitäten beibehalten und sich von Missverständnissen erholen, dank einer gemeinsamen Vereinbarung über den Anwendungsbereich; so dass Sie, wenn ich sage „f(x) = 2x + 3“, nur an die spezifischen Kontexte denken, in denen dieser Ausdruck nützlich ist.

Sie sehen, was für ein hochrangiges, nischenhaftes und esoterisches Gebiet die formale Logik ist. Sie ist ein hauchdünner, silbriger Streifen am Rande eines viel größeren Teils des menschlichen Denkens, das informell, willkürlich und voller zufälliger freier Assoziationen ist. Die Formalisierung ist ein freiwilliges Unterfangen, das Sie unternehmen, um Ihr Denken zu zügeln, um Ihre Gedanken in gesellschaftlich vereinbarte Muster konkreter Symbole einzupassen. Es ist ein „unnatürliches“ Zugeständnis, das man macht, um in einer Gesellschaft gut zu leben.

Wenn das natürliche Bewußtsein sich gleich der Wissenschaft anvertraut, versucht es, veranlaßt durch was auch immer, auch einmal auf dem Kopf zu gehen; der Zwang, diese ungewohnte Haltung einzunehmen und in ihr umherzugehen, ist eine Gewalt, die es sich selbst antun soll, ganz unvorbereitet und scheinbar ohne Notwendigkeit. – Hegel, Phänomenologie des Geistes, Vorwort

[Dies legt nahe, dass unmittelbares, intuitives analoges Denken unsere primäre Art des Denkens ist, während logisches, sequenzielles Denken eine viel spätere Entwicklung ist – Deep Learning For AI, Yoshua Bengio, Yann Lecun, Geoffrey Hinton

Motiviertes, nicht-logisches Denken ist unsere Standardmethode, sich mit der Welt auseinanderzusetzen. Aus diesen Wurzeln wächst die formale Logik wie ein gut beschnittener Zweig. Die formale Logik ist nur eine Spielart des motivierten Denkens, bei der versucht wird, Sprache und Symbole an einen gemeinsam vereinbarten Satz von Regeln anzupassen. Ein perfektes und umfassendes logisches System – eines, das auch mit der realen Welt übereinstimmt – ist ein akademischer Traum. Es ist ein imaginäres Ideal am Ende eines langen Weges, der bis heute nur eine Reihe unvollkommener Formalisierungen hervorgebracht hat.

Dass die logisch-symbolische KI diese Hierarchie umkehrt und vorschlägt, dass die formale Logik ein notwendiger Baustein der menschlichen Kognition ist, ist, gelinde gesagt, optimistisch. Eine Handvoll statischer, eingebauter Operatoren könnte niemals die lebendige Geschichte gemeinsamer Absichten vermitteln, die in jedes Prädikat und jede logische Operation einfließen. Von einem Computer zu erwarten, dass er das gesamte organische Erbe der vorkompilierten Operatoren zurückverfolgen kann, bedeutet, dass er zur Telepathie fähig sein muss.

Verhängnisvolle Abkürzungen

Sie mögen gegen den letzten Absatz einwenden. „Warum nicht formale Logik in eine KI programmieren? Warum soll jede KI das Rad für sich selbst neu erfinden? Wir haben fertige Abkürzungen. Wir haben bereits solide Formeln abgeleitet. Wir sollten ein System entwickeln, das sie mechanisch oder probabilistisch anwenden kann – Aufgaben, bei denen sich Computer auszeichnen. Dadurch wäre die KI einfacher zu trainieren und die Ergebnisse wären leicht zu messen. Im Vergleich dazu sind soziale Interaktionen chaotisch, mühsam zu implementieren und letztlich unnötig.“

Oder vielleicht überzeugt Sie Ihre Intuition davon, dass die formale Logik in gewisser Weise die Art und Weise widerspiegelt, wie die objektive Welt funktioniert, und dass die Beschränkung der Überzeugungen einer KI auf solche Regeln ein effizienter Weg ist, um ihre Ziele zu erreichen. Unter diesem Gesichtspunkt stellt subjektives, motiviertes oder anderweitig irrationales Denken eine Störung Ihres ungefilterten, wahren Verständnisses dar – ein Versagen, die Welt so zu sehen, wie sie ist. Eine gute KI täte gut daran, solche allzu menschlichen Schwächen zu überwinden. Von dieser Annahme gehen die meisten logischen KIs aus.

Eine Fallstudie für diesen zum Scheitern verurteilten Ansatz ist das Logic Tensor Network (LTN). Dabei handelt es sich um eine Art neurosymbolische KI, deren Ziel es ist, einem neuronalen Netz zu ermöglichen, automatisch zu bestimmen, wie wahrscheinlich es ist, dass eine Aussage wahr ist. Dies geschieht, indem logische Axiome als Einschränkungen im Vektorraum eingebettet werden, so dass ein Modell darauf trainiert werden kann. Logic Tensor Networks – wie alle neurosymbolischen KI – bauen eine Ebene der symbolischen Abstraktion in ihre Infrastruktur ein und eine Ebene der Logik darüber. Sobald die Symbole geerdet sind, ist die Bestimmung der Wahrheit von Prädikaten eine Übung in Gewichtsoptimierung.

Bei der neuronal-symbolischen Berechnung kann die Logik als eine Sprache betrachtet werden, mit der ein neuronales Netz kompiliert werden kann…

Sobald Symbole auftauchen (was auf verschiedenen Abstraktionsebenen geschehen kann, idealerweise innerhalb einer modularen Netzwerkarchitektur), kann es aus rechnerischer Sicht produktiver sein, sich auf solche Symbole zu beziehen und sie symbolisch statt numerisch zu bearbeiten (d.h. zu berechnen). – Neurosymbolische KI, die 3. Welle

Logische Tensornetzwerke bauen aufgrund ihres Designs die Axiome in ihre Netzwerke ein, die Sie und ich freiwillig eingeben; zum Beispiel, dass eine Person nicht gleichzeitig Raucher und Nichtraucher sein kann. Solche Einschränkungen sind für die KI universell und verbindlich für den gesamten Raum der Überzeugungen. Doch obwohl dies nach einer guten Sache, ja sogar nach etwas Übermenschlichem klingen mag, sind sie mit zwei entscheidenden Nachteilen konfrontiert. Erstens können sie das Netz immer nur auf diese wenigen fest kodierten Regeln beschränken. Sie sind nicht in der Lage, wie Sie, als Reaktion auf sozialen Druck neue Axiome oder Beschränkungen zu entdecken und hinzuzufügen.

Das [Logical Tensor Network] ist ein Rahmenwerk für das Lernen in Anwesenheit von logischen Einschränkungen. LTNs teilen mit [einer anderen Arbeit] die Idee, dass logische Beschränkungen und Trainingsbeispiele einheitlich als Supervisionen eines Lernalgorithmus behandelt werden können – Logic Tensor Networks: Deep Learning und logische Schlussfolgerungen aus Daten und Wissen

Schlimmer noch, das LTN kann nicht wissen, wann es sinnvoll ist, seine Transformationen anzuwenden und wann sie nicht nützlich sind. Die standardmäßige Bindung an mechanisches, logisches Denken ist selbst eine lähmende Einschränkung. Es schließt das freie, metaphorische Denken aus, das den Löwenanteil der alltäglichen Wahrnehmung ausmacht (verstehst du? „Löwenanteil“ ist eine Metapher). Die Verwendung von LTNs muss also auf konkrete Konzepte und idealisierte Beziehungen – wie „Raucher“ oder „Eltern“ – in vorbereiteten Sandkastenumgebungen beschränkt werden. Wenn man ihnen etwas Poesie hinzufügt, wird ihre Wirksamkeit stark gemindert.

Logik ist eine Wahlmöglichkeit

Menschliche Gehirne wenden Logik nicht mechanisch, unaufgefordert und ohne Rücksicht auf den Kontext an. Logisch zu sein ist immer eine Entscheidung. Sie können z. B. glauben, dass „Menschen, die für wohltätige Zwecke spenden, gut sind“, und auch, dass „Bob für wohltätige Zwecke spendet“. Aber Sie sind in keiner Weise verpflichtet zu glauben, dass „Bob gut ist“, wenn Sie den Mann nicht mögen.

Sie sind auch nicht gezwungen, eine der ersten beiden Überzeugungen zu ändern, selbst wenn Ihre Freunde ein solches Verhalten anstößig finden. Pech für sie. Es ist deine Meinung, und du wirst dich nur dann bemühen, sie zu bereinigen, wenn du das Gefühl hast, dass du es brauchst. Vielleicht gibt es sogar eine Interpretation der Aussagen, die es rechtfertigt, sie so zu lassen, wie sie sind. Solange Sie das noch nicht herausgefunden haben, können Sie natürlich beschließen, solche Widersprüche nicht laut auszusprechen… und hier sehen wir wieder den Zweck der Logik – zu regeln, was Sie anderen sagen, nicht was Sie selbst denken.

Wenn Ihr Ziel darin besteht, eine adaptive logische KI zu entwickeln, die Regeln auf mehr als nur auf unter Quarantäne stehende Spielzeugprobleme anwenden kann, dann ist die Festcodierung von Axiomen und Operatoren eindeutig unzureichend. Das System darf logische Konsistenz nicht als ein prokrustesartiges Bett betrachten, in das es alle Arten von Erfahrungen und Aufgaben hineinpasst, sondern als ein lebendiges Repertoire selbst auferlegter Denkbeschränkungen, die von Fall zu Fall hinzugefügt und im Kontext verankert werden.

Und da Logik eine Einschränkung von Sprache und Symbolen ist, braucht die KI ein Kommunikationsmedium, über das Ihre Mitmenschen unpraktische Behauptungen korrigieren können⁷. Sie werden ihre Korrekturen auf das zuschneiden, was sie für notwendig halten, so dass idiomatische Metaphern nicht auf dem gleichen Niveau geprüft werden wie mathematische Beweise. Die Erwartung, dass eine künstliche Intelligenz all diese Nuancen isoliert ableiten kann, vernachlässigt, dass, wie Sie im ersten Beitrag gesehen haben, formale Logik für ein isoliertes Individuum keinen Nutzen hat (siehe Fußnote 6 in diesem Beitrag).

Eine künstliche Intelligenz auf diese Weise zu trainieren ist ein langwieriger Prozess, aber machbar⁸. Außerdem ist er nicht optional. Jeder Mensch und damit auch jede KI, die das Problem des Prädikatsscopings überwinden und ihre Verwendung der formalen Logik fest verankern will, muss die vorangehenden Entwicklungsstufen durchlaufen. Den Endpunkt zu überspringen oder dem Netzwerk selbst logische Axiome aufzuzwingen, ohne die vorangegangenen Kommunikationskämpfe und prägenden Momente zu berücksichtigen, bedeutet, dem Körper, der ihn trägt, den Kopf abzuschlagen. Durch die Vernachlässigung der gemeinsamen sozialen Motivationen, die sie hervorgebracht haben, werden die Prädikate und Operationen der formalen Logik, auch wenn sie rechnerisch nachgeahmt werden können, einen engen, brüchigen Anwendungsbereich haben. Die KI wird so sein wie ich in dem Beispiel, mit dem diese Serie begann: voller Missverständnisse und scheinbar stur in ihrem Denken, wie ein böser Geist, der versucht, Ihre Ziele zu unterlaufen.

Vielen Dank an Graham Toppin für das Lesen des ersten Entwurfs dieser Serie.

Wenn Sie diese Serie interessant fanden, würde ich mich freuen, einige der feineren Details dieses Prozesses zu besprechen, die aus Gründen der Kürze ausgelassen wurden.

1 Bei der Analyse eines Begriffs geht es nicht darum, herauszufinden, was der Begriff bereits in sich selbst enthält (z. B. Junggeselle enthält unverheiratet und Mann). Vielmehr fügt man solche Details hinzu, indem man Informationen anhängt, die man später entdeckt und die man für sinnvoll hält. Wenn man Junggeselle lernt, könnte man (und tut dies auch häufig) zunächst lernen, einen Junggesellen anhand scheinbar nebensächlicher Merkmale zu identifizieren, wie z. B. sorglos oder schlampig zu sein; all dies, ohne etwas über unverheiratet oder Mann zu wissen. Dies ist eine vernünftige erste Annäherung, und nur wenn sie fehlschlägt, fügt man Korrekturen hinzu. Die Begriffsdefinition ist also immer synthetisch im kantischen Sinne, niemals analytisch.

2 In ihrem Anfangsstadium sind alle Begriffe kaum mehr als intuitive mentale Reaktionen. In manchen Fällen hören sie nie auf, so zu sein. Eine solche Betrachtungsweise löst viele Probleme im Zusammenhang mit der Entstehung abstrakter Begriffe. Sie erklärt, warum sich manche Begriffe einer objektiven Definition widersetzen, wie man an den ständigen Debatten über die Definition von „Kunst“, „Schönheit“ oder „Spiel“ sieht. In diesen Fällen ist die unbewusste, implizite Definition die einzig verfügbare.

3 Aus dieser Beschreibung sollte klar hervorgehen, dass ein Konzept, wie ein Symbol, keine neue Art von psychischem Objekt ist. Es ist ein konkreter Satz von Erinnerungen, in der Regel von Wortklängen, die mit anderen konkreten Erinnerungen verbunden sind. Es handelt sich also nicht um eine „Abstraktion“, wie bei einem Symbol. Seine vereinheitlichenden Eigenschaften ergeben sich aus einem oder mehreren zugrunde liegenden Motiven, die diese Erinnerungen zusammenhalten. Diese Motive wirken wie ein Magnet und ziehen Problem- und Lösungserinnerungen zusammen – und ein Wort ist eine solche Lösung. Mehr über die mechanischen Details der Sprache als interaktives linguistisches Werkzeug können Sie in Sprache und Motivation in Chatbots lesen.

⁴ Hier gibt es Parallelen zu alten kulturellen Traditionen, die glaubten, dass man Macht über eine Idee hat, wenn man ein Wort dafür hat. Auch heute noch lässt es ein Problem kontrollierbarer und vertrauter erscheinen, wenn man ihm einen Namen gibt (wie „Depression“ oder „Unsicherheit“). Denn wenn es einen Namen hat, können die Menschen das Problem verstehen und sich darum scharen, und man kann ihre Hilfe in Anspruch nehmen. Ein Wort für ein Problem zu haben, bedeutet also, so etwas wie eine praktikable Option oder einen Plan zur Lösung des Problems zu haben. Die Suche nach einem Namen für ein Problem gilt also als eine Art Lösung.

⁵ Mit anderen Worten: Dialektik.

⁶ Die Behauptung hier ist, dass symbolische Abstraktion eine Aktivität ist, die in der realen Welt durch gemeinsamen Diskurs stattfindet, nicht in einer Schicht, die in das Netzwerk eines Gehirns eingebaut ist. Sowohl die Konzeptualisierung als auch die Formalisierung sind Übungen in Abstraktion.

7 Wir sind so sehr daran gewöhnt, unsere abstrakten Gedanken als direkte, selbst geschaffene Repräsentationen der Realität zu verstehen, dass wir uns oft nicht bewusst sind, wie sozial konditioniert sie sind. Selbst wenn man beispielsweise ein reiner Forscher wäre, könnte man eine wirklich innovative Idee nur dann vermitteln, wenn man Konzepte verwendet, mit denen andere vertraut sind und die sie verstehen; der Raum für neue Entdeckungen ist also eingeschränkter, als man vielleicht hoffen würde.

8 In diesem Artikel habe ich Begriffe wie „Problem“, „Lösung“, „Denken“ und „Lernen“ verwendet. Es versteht sich von selbst, dass die genauen Mechanismen, die sich hinter diesen Begriffen verbergen, einer weiteren Ausarbeitung bedürfen. In anderen Beiträgen können Sie mehr darüber lesen, wie Gedanken mit anderen Gedanken verbunden werden können, wie Probleme und ihre Lösungen entstehen und wie sie das Lernen vorantreiben. Sie können auch Beispiele für das Denken sehen, die als Code-Demos visualisiert werden. Zusammen mit diesem Beitrag bilden sie einen Rahmen und eine Blaupause für einen Agenten, der logische Konzepte entwickeln soll, angefangen von freien Assoziationen bis hin zu fundiertem, formalem Denken. Wenn Sie etwas davon interessiert, lassen Sie es mich wissen, und ich würde mich freuen, darüber zu diskutieren, wohin dieses Projekt führt.

(c) Einleitung: Dirk Boucsein, Gastbeitrag: Yervant Kulbashian

The Green Swan: Part 3

A Thin Layer of Symbols

Read part 1 and part 2 of the series.

Let’s finally look at formal logic: the abstract rules, symbols and operations that most of us only become acquainted with after high-school — if at all.

Generally, when you use logic you use it informally, as a specific reaction to the current situation. If a friend told you his head ached all day, you’d know not to ask if he had had a good day. You could call this ‘practical’ or ‘implicit’ logic, since it’s not based on any formalized rule. You confirm that it was valid when it saves you from embarrassment. This is similar to your everyday understanding of morality: you may know roughly on a case-by-case basis what is and is not immoral, without having any overarching theory of morality.

To develop your thinking from this implicit stage to formal logic, you must first go through a stage of conceptualization or abstraction. In this step, you come up with words for logical concepts, and learn how to apply them to multiple similar examples.

This step incidentally brings us face to face with perhaps the most interesting and difficult challenge in all of A.I., namely “how do abstract concepts arise in a mind?” Logical concepts like “complete”, “incorrect”, “valid”, “opposite”, “truth” etc. have until now been assumed to be ‘givens’, and as such they are implicitly built into each A.I. that tries to use them. This is largely because having the A.I. derive them on its own seemed out of the question. As you‘ll see below, an A.I. can in fact produce such concepts from scratch, based solely on its motives and its collaboration with other people.

Words as Concepts

When an infant says the word “mama”, her goal is not to merely identify or describe her mother. Rather she wants help, or attention, or interaction. It may be short for “look at what I did!” She may later transfer the word to other adults, and even to objects if doing so helps her get attention. In the same way, every word you use is a tool: you only learn it when you discover it is part of solving a problem.

Consider the word “truth”. You can trace its origin in your mind to a desire to settle debates, or mitigate doubts in people you care about. For instance, as a child witnessing a tense back-and-forth between family members disagreeing on an uncertain topic, you may hear someone mention that they should find out the “truth” about the issue. This word seemed to change the tone of the conversation and may have eased the tension in the air, though you didn’t know why. To you the words may equally well have meant “stop debating” or “calm down”.

Later another debate arose, this time between your friends; and along with it a new tension. At some point one of your friends spoke in a tone or mentioned something that reminded you of the first conflict, and the words “find out the truth” popped into your head. So you said them aloud, hoping it would get them to “calm down”.

Being slightly older, but still young and impressionable, your friends deferred to the cultural authority they had been taught to instill in the words “the truth”. So as before, this phrase seemed to ease the tension. Your mind now transferred the phrase and it became a response to both situations. It would subsequently get elicited in your thoughts in similar situations.

As yet you had no deep understanding of the word’s meaning or its implications. Indeed your first attempt at defining the word would likely have been wrong1. As with most new words that you picked up in conversation, you first knew it by its feeling — that inarticulable context in which the word seems appropriate. That feeling is actually a gestalt or composite of all the problem contexts for which the word was found to be a solution.

You may have noticed that unlike the more popular ‘didactic’ model of concept acquisition, the process of learning concepts described here works in the opposite direction. You didn’t start by learning the objective dictionary definition of the concept “truth”, and then use the concept to solve problems. Rather you learned methods of solving interpersonal problems using the word as a set of sounds, then gradually elaborated on this initial sketch through self-reflection and dialectic to create a more and more refined picture of “truth”. In short, first you did the concept, and only later you understood it.2

All linguistic concepts begin their lives this way, as solutions to social problems. This is the indefinable bond that connects diverse and seemingly incompatible experiences into a single abstraction. Take any abstract concept and ask yourself what all its instances have in common. This should include instances where the word is used as a metaphor; for instance the word “window” as used in “the eyes are the windows to the soul”. You will find that the only connective tissue is the motivation that drove you to learn that word.

Looked at this way, there’s no need to posit a built-in psychological mechanism that drives the creation of concepts, or even of symbols. You don’t need to assume the existence of a native neural structure which automatically pulls together similar examples under one common “concept” node³. The simple process of triggering conditioned memories is enough to emulate both.

To be sure, similarity still matters. In the example above, there was a similarity in the two debates which triggered a memory of the word “truth”. You could consider this a case of learning “by association”. However, similarity is not enough; the phrase stuck in the new context because it also addressed the problem at hand. This is a critical and often neglected ingredient in psychological models which explain how humans generalize concepts. The social context, the problem, and the linguistic term all play a necessary role in transferring a word from one situation to another.

A Rallying Banner

Over the span of many such experiences you attached the same words to more and more situations. As when you were an child, social motives continued to drive learning into your youth. The difference now was that you were dealing with more nuanced situations, involving mature adults.

The words that were now flying around in your head acted like glue that you could use to connect diverse and otherwise unrelated experiences, including memories. As you saw in part two, there is only a minor difference to the mind whether an experience happens in thought or in reality. This resulted in a bootstrapping process by which you solved problems using only your memories of conversations and their relations to value-laden words.

For example, one day, as a teen, you may have been moping and feeling upset at constantly being refuted. You introspect on a memory of a bad experience. You add to it memories of others that involve similar words or sights, and your interpretations of these memories. Then, a peer with analogous problems helps you discover a word that you can use to communicate your issue out loud: e.g. “validity”.

Over time, you grew an informal logical vocabulary that you could put to use in everyday conversations. For instance:

- You learned the word “consensus”: a way to avoid unending arguments that waste everyone’s time.

- You learned the word “validity”: a set of procedures for defending an assertion when others express doubt.

- You learned the word “conditional”: the option to readjust and specify an assertion when confronted with obviously disproving cases.

- And you learned the word “truth”: a way of addressing our shared doubts and uncertainties.

One major difference between youth and infancy, however is you had since developed a theory of mind: the ability to imagine what others are thinking, and by virtue of that to sympathize with their problems. When you were a child, saying the ‘right words’ merely got you out of trouble or impressed adults. Now, your newfound empathy meant you could learn words which solved problems not just for you, but for a group of people around you. Giving a problem a name and saying it aloud helped focus other’s attention on the common difficulty. The act of learning and speaking the word itself thus became a type of solution⁴.

That’s what you did with word “truth” above: it served as a banner around which people who were similarly perturbed rallied to solve an underlying problem. This is still true even though it may have solved different problems for each of you. The word had become intersubjective: it enabled other people to partake in and collaborate on a common issue.

Formalization

Intersubjectivity is handy trick, but it doesn’t remove misunderstanding completely. You soon find that words like “truth” or “inconsistency” are still ambiguous. Given your friends’ idiosyncratic experiences, different associations or experiences get attached to the word “truth” for you as for them — therefore using that word doesn’t always have the intended effect.

If you still find yourself frustrated by misunderstandings, you may decide to go further down this path, and begin to learn about formal logic. Formal logic is a set of shared, fixed templates you can use to pare away the messy nuance, individual variation, and subjectivity that can scuttle everyday conversations. This is a second meta-level of problem solving. The problem now is that of the ambiguity inherent in communication. Words themselves have become an obstacle; and still a social one at that.

Where informal words may have multiple incompatible interpretations, formalization makes the common language concrete and removes confusion when discussing an issue with others. Shared symbols such as “all” (∀) or “not” (¬) establish a restricted workspace for clarifying disagreements to help you reach a consensus — at least that’s what they’re intended to do. Usually this only works in very narrow domains, and only as long as you all agree on what the terms mean and how they interact.

The development of any such symbolic system always entails a long struggle over shared ideas, give-and-take, misunderstanding and clarification⁵. The history of 20th century logic, starting from Frege’s formalization, and its refutations by Quine and Dennett, has been a living record of such exchanges. Only when everyone involved achieves a tentative consensus in a particular domain — like fuzzy logic, or logic programming — does it crystallize into symbolic formulas and equations. The same has been true of any field of study where symbols are used, such as math or chemistry. Symbols represent the apotheosis of mutual comprehension.

The goal, for you or anyone interested in the study of symbolic logic, is to move the entire conversation into an abstracted space of shared symbols. “Abstraction” here doesn’t mean a set of latent or generalized mental representations as it does in A.I.; it means an adjacent space of real words and images that you (and others) elicit in your mind in response to the original inputs. They are called “abstract” because they do not directly reference the images and sounds in the subject matter itself; you replace those with another set of commonly understood symbols⁶.

The end result is rigid, concrete, and formulaic. It is designed to be so for people to communicate clearly in such critical fields as engineering. And it can maintain these qualities and recover from misunderstandings thanks to a shared agreement about scope; so that when I say “f(x) = 2x + 3” you only bring to mind the specific contexts in which that expression is useful.

You can see what a high-level, niche, and esoteric activity formal logic is. It is a paper-thin, silvery fringe at the edges of a much larger body of human thought, which is informal, arbitrary, and full of haphazard free-association. Formalization is a voluntary endeavour you undertake to rein in your thinking, to fit your thoughts into socially agreed upon patterns of concrete symbols. It is an “unnatural” concession you make to live well in a society.

When natural consciousness entrusts itself straightway to Science, it makes an attempt, induced by it knows not what, to walk on its head too, just this once; the compulsion to assume this unwonted posture and to go about in it is a violence it is expected to do to itself, all unprepared and seemingly without necessity. — Hegel, Phenomenology of Spirit , Preface

[This] suggests that immediate, intuitive analogical reasoning is our primary mode of reasoning, with logical sequential reasoning being a much later development – Deep Learning For AI, Yoshua Bengio, Yann Lecun, Geoffrey Hinton

Motivated, non-logical thinking is your default way of addressing the world. Out of these roots formal logic grows like a well-pruned branch. Formal logic is just a flavour or type of motivated thinking, one that tries to conform language and symbols to a communally agreed upon set of rules. A perfect and comprehensive logical system — one that also aligns with the real world — is an academic dream. It’s a imagined ideal at the end of a long road that has, to date, delivered only a string of imperfect formalizations.

For logical-symbolic A.I. to reverse this hierarchy and propose that formal logic is a necessary building block of human cognition is optimistic, to say the least. A handful of static, built-in operators could never communicate the living history of shared intentions that went into every predicate and logical operation. To expect a computer to reverse-engineer all that organic legacy from pre-compiled operators is to expect it to be capable of telepathy.

Doomed Shortcuts

You may object to that last paragraph. “Why not program formal logic into an A.I.? Why ask each A.I. to reinvent the wheel for itself? We have ready-made shortcuts. We’ve already derived sound formulas. We should design a system that can apply them mechanically or probabilistically — tasks at which computers excel. This would make the A.I. simpler to train, and the results easy to measure. Compared to that, social interactions are messy, arduous to implement, and ultimately unnecessary.”

Or perhaps your intuition is persuading you that formal logic in some way mirrors the way the objective world works, and that constraining an A.I.’s beliefs to such rules is an efficient way for it to achieve its goals. From this standpoint subjective, motivated, or otherwise irrational thinking represents a disruption into your unfiltered, true understanding — a failure to see the world as it is. A good A.I. would do well to leap-frog over such all-too-human foibles. This is the assumption around which most logical A.I.s are designed.

A case study of this doomed approach is the Logic Tensor Network (LTN). It’s a type of neurosymbolic A.I. whose goal is to allow a neural network to automatically determine how likely a statement is to be true. It does so by embedding logical axioms as constraints on vector space so that a model can be trained to fit them. Logic Tensor Networks — like all neurosymbolic A.I. — build a layer of symbolic abstraction into their infrastructure, and a layer of logic on top. Once symbols are grounded, determining the truth of predicates is an exercise in weight optimization.

In neural-symbolic computation, logic can be seen as a language with which to compile a neural network…

Once symbols emerge (which may happen at different levels of abstraction, ideally within a modular network architecture), it may be more productive from a computational perspective to refer to such symbols and manipulate (i.e. compute) them symbolically rather than numerically. — Neurosymbolic A.I., The 3rd Wave

As a consequence of their design, Logical Tensor Networks build into their networks the axioms that you and I put in voluntarily; for example, that a person can’t be a smoker and also not be a smoker at the same time. Such constraints are, to the A.I., universal and mandatory across its entire space of beliefs. But although this may sound like a good thing, superhuman even, they are faced with two critical handicaps. First, they can only ever constrain the network to these few hard-coded rules. They are unable, like you, to discover and add new axioms or constraints in response to social pressures.

[Logical Tensor Network] is a framework for learning in the presence of logical constraints. LTNs share with [another paper] the idea that logical constraints and training examples can be treated uniformly as supervisions of a learning algorithm — Logic Tensor Networks: Deep Learning and Logical Reasoning from Data and Knowledge

Worse still, the LTN can’t know when it would make sense to apply its transformations and when they are not useful. Being yoked by default to mechanical, logical thinking is itself a crippling limitation. It closes off free-form, metaphorical thinking, which comprises the lion’s share of everyday cognition (get it? “lion’s share” is a metaphor). So the use of LTNs must be restricted to concrete concepts and idealized relationships — like “smoker” or “parent” — in prepared, sandbox environments. Throw some poetry at them and their effectiveness is severely diminished.

Logic is a Choice

Human brains don’t apply logic mechanically, unbidden, and heedless of context. Being logical is always a choice. You may, for instance, believe that “people who give to charity are good”, and also that “Bob gives to charity”. But you are in no way obliged to believe that “Bob is good” if you don’t like the guy.

Nor are you forced to change either of your first two beliefs, even if your friends find such behaviour objectionable. Tough for them. It’s your mind, and you’ll only put in the effort to clean it up when you feel you need to. There may even be some interpretation of the statements that justifies leaving them as they are. Of course, until you discover this, you may prudently decide not to express such contradictions aloud… and here again we see the purpose of logic — to regulate what you say to others, not what you think to yourself.

If your goal is to build an adaptive logical A.I., one that can apply rules to more than just quarantined toy problems, then hard-coding axioms and operators is clearly insufficient. The system must treat logical consistency not as a Procrustean bed into which it fits all types of experiences and tasks, but as a living repertoire of self-imposed constraints on thinking, each one added on a case by case basis, and anchored in context.

And since logic is a constraint on language and symbols, the A.I. needs a medium of communication through which your peers can correct impractical assertions⁷. They’ll tailor their corrections based on what they deem necessary, so that idiomatic metaphors aren’t held to the same level of scrutiny as mathematical proofs. To expect an A.I. to derive all this nuance working in isolation neglects that, as you saw in the first post, formal logic has no utility for an isolated individual (see footnote 6 in that post).

Training an A.I. in this way is a long process, but it’s doable⁸. Moreover it’s not optional. Every person, and by extension every A.I. that wants to overcome the predicate scoping problem and firmly ground its use of formal logic must go through the preceding developmental stages. To skip to the endpoint, or to strong-arm logical axioms into the network itself, without the antecedent communication struggles and formative moments is to cut the head off the body that sustains it. By neglecting the shared social motivations that gave rise to them, the predicates and operations of formal logic, though they can be computationally aped, will have a narrow, brittle scope. The A.I. will be like I was in the example that began this series: full of misunderstanding and apparently stubborn in its thinking, like an evil genie trying to subvert your aims.

Thanks to Graham Toppin for reading the first draft of this series.

If you found this series interesting, I’d be glad to discuss some of the finer details of this process which were left out for brevity.

1 Analyzing a concept is not about discovering what the concept already contains in itself (e.g. bachelor contains unmarried and man). Rather you add such details by tacking on information you later discover, and deem reasonable to add. When learning bachelor, one could (and frequently does) first learn to identify a bachelor based on apparently ancillary features, such as being carefree or slovenly; all without knowing about unmarried or man. This is a reasonable first approximation, and only when it fails do you add corrections. Concept definition is therefore always synthetic in the Kantian sense; never analytic.

2 In their initial stages, all concept-words are little more than intuitive mental responses. In some cases they never stop being so. Looking at it this way resolves many issues around how abstract concepts are created. It explains why some concepts resist being defined objectively, as seen in ongoing debates over the definition of “art”, “beauty” or “game”. In these cases the unconscious, implicit definition is the only one available.

³ It should be clear from this description that a concept, like a symbol, is not a new type of psychic object. It is a concrete set of memories, usually of word sounds, that are attached to other concrete memories. This means it is not an “abstraction”, as in a symbol. Its unifying properties arise from an underlying motive(s) that stitches these memories together. These motives work like a magnet, drawing together problem and solution memories — and a word is one such solution. You can read more about the mechanical details of language as an interactive linguistic tool in Language and Motivation in Chatbots.

⁴ There are parallels here to ancient cultural traditions which believed that having a word for an idea gave you power over it. Even today, giving a problem a name (like “depression” or “uncertainty”) makes it seem more controllable, more familiar. This is because if it has a name, people can understand and rally around the problem, and you can conscript their help. To have a word for a problem is therefore to have something like a viable option or plan to solve it. Thus you count the act of finding a name for a problem as a type of solution.

⁵ In other words, dialectics.

⁶ The claim here is that symbolic abstraction is an activity that happens in the real world through shared discourse, not in a layer built into the network of a brain. Both conceptualization and formalization are exercises in abstraction.

⁷ We are so used to construing our abstract thoughts as direct, self-created representations of reality, that we often don’t realize how socially conditioned they are. For instance, even if you were a pure research scientist, you could never communicate any truly innovative idea except by using concepts others are familiar with and understand; so the space of new discoveries is more restricted than you might hope.

⁸ Throughout this article, I’ve used terms like “problem”, “solution”, “thought”, and “learn”. It goes without saying that the exact mechanisms behind these terms beg for further elaboration. You can read more in other posts about how thoughts can connect to other thoughts, how problems and their solutions are derived, and how they drive learning. You can also see examples of thinking visualized as code demos. Together with this post, they comprise a framework and blueprint for an agent to develop logical concepts, beginning from free-form association to sound, formal thinking. If any of this interests you, let me know, and I’d be glad to discuss where this project is going.

(c) Yervant Kulbashian

https://orcid.org/0009-0008-6932-2717

https://orcid.org/0009-0008-6932-2717

Ich glaube, mit meiner Logik ist es nicht weit her, denn ich kann mit dieser Art des Umgangs mit Worten gar nichts anfangen. Ich denke eher rational, was sich in der Suche nach den Worten ausdrückt, die diesem Denken entsprechen könnten. Es ist aufwändiger, denn oft bestehen die gegebenen Worte nicht mehr durch den Zusammenhang mit ihrem Ursprung und müssen ihm erst wieder zugeführt werden, bevor sie seinen Sinn ergeben. Das benötigt ein Einfühlungsvermögen in das Gegenüber, dem ich gewachsen sein muss, damit ich nicht an ihm verloren gehe. In seiner Substanz will ich meinem Gegenüber alle Möglichkeiten anbieten, die uns beide in unserer Kommunikation und damit auch im gegenseitigen Verständnis weiter bringen. Dafür greife ich auf das Gedächtnis zurück, dem ich mein ganzes Leben verdanke. Genau da liegt der springende Punkt, denn ich weiß nicht, wie das genau funktioniert, doch ich versuche dabei mich selbst zu hinterfragen und meinem eigenen Denken in einer Weise näherzukommen, die seine Grenzen überwinden kann. Dabei endet und beginnt mein Gedankenfluss immer bei Gott, sozusagen als Ausgangspunkt und Endpunkt einer persönlichen Substanz, die mir zur Verfügung steht. Woraus ich diese Substanz gewinne, das unterscheidet sich durch mein Gegenüber, das mich fordert oder vielleicht auch braucht, wofür auch immer. Ohne ein gleichwertiges Gegenüber wäre meine Substanz wohl wertlos und würde in etwas enden, das sich seiner weder annehmen will noch kann. Sobald ich jedoch einem gleichwertigen Partner verbunden bin, lebt meine Substanz von seiner Resonanz und gewinnt etwas für sich, was sich nur schwer beschreiben lässt. Vielleicht bin ich es selbst, oder aber nur die Form, in die ich gepresst wurde, damit ein formales Ergebnis möglich wird. Es ist wirklich schwer meine Substanz in ihrer Relevanz so zu definieren, dass ihr Wert schon immer besteht, jedoch in einer Einheit, die rein informellen Charakter besitzt. Der wirkt sich zwar wertsteigernd auf die Substanz aus, ist jedoch für meine derzeitige Lebensform irrelevant.

Um zumindest den Begriff Wahrheit in ihrem obigen Text nicht ganz zu ignorieren, so spreche ich sie nicht nur aus, denke dann aufgrund der Resonanz über sie nach und versuche herauszufinden, was ich falsch gemacht haben könnte. Ich rekonstruiere anhand ihrer Ergebnisse, was sie verursacht, sozusagen in meiner Handlungsweise, durch die ich lerne, mit der Wahrheit so umzugehen, dass ich damit niemandem schade und schon gar niemanden damit verletze. Ich denke, das Ziel der Wahrheit liegt einzig in dem, der sie nicht nur anspricht, sondern auch ausspricht, was das mit sich bringt. Es kostet viel mehr Kraft, der Wahrheit standzuhalten, als ihr auszuweichen oder sie gar zu ignorieren. Demzufolge bringt die Wahrheit jedoch auch viel mehr Arbeit mit sich, als es die Lüge erfordern könnte, sodass Wahrheit letztendlich der Würde dient, die sich aus ihr ergibt.

Auch wenn dieser Beitrag an sich nicht viel für mich ergeben hat, so konnte ich durch ihn in mir danach suchen, was vielleicht einer weiteren Aufklärung dienen kann.

Lieber C. M.,

vielen Dank für das Lesen und Ihr Interesse an meinen Essays.

Stimmt, ich finde Noah Yuval Hararis Bücher „Homo Deus – Eine Geschichte von Morgen.“ und „21 Lektionen für das 21. Jahrhundert“ auch sehr inspirierend, obwohl nicht unbedingt seine Humanismus-Kritik teilen möchte.

Ihren Witz mit dem „schwarzen Schaf“ in Schottland fand ich sehr gelungen, da er genau „den Finger in die Wunde legt“:

Der Biologe sagt: „In Schottland sind die Schafe schwarz.“

Der Physiker entgegnet: „Keineswegs, wir müssen uns an das halten, was wir beobachtet haben: Man kann sagen, dass es in Schottland mindestens ein schwarzes Schaf gibt.“

Der Mathematiker schlussfolgert: „In Wirklichkeit kann man nur sagen, dass es in Schottland mindestens ein Schaf gibt, dessen eine Seite schwarz ist.“

Die hierarchische Emergenz in den Naturwissenschaften in Bezug auf das „Phänomen“ habe ich bis heute nicht verstanden und halte es eher für eine Form des Reduktionismus, welche der Sache nicht gerecht wird. Man könnte den Witz auch umschreiben:

Der Biologe sagt: „In Schottland sind die Schafe schwarz.“

Der Physiker entgegnet: „Keineswegs, wir müssen uns an das halten, was wir beobachtet haben: Man kann sagen, dass es in Schottland Schaf gibt, deren Fell alle Lichtfrequenzen absorbiert.“

Der Mathematiker schlussfolgert: „In Wirklichkeit kann man nur sagen, dass es in Schottland Schafe gibt, dessen RGB-Farbraum den Wert RGB = (0, 0, 0) besitzt.“

Welche Beschreibung genauer ist, lassen wir einfach mal dahingestellt, weil es eigentlich gar keinen großen Unterschied macht ;-).

Viele Grüße

Philo Sophies

Seit Gödel geistert die formale Logik als Untote durch die Wissenschaft. Sie ist nicht einmal in der Lage die Arithmetik auf sich zu reduzieren ohne entweder widersprüchlich zu sein oder unvollständig. Nichts weiß sie über Mathematik, Physik, Chemie oder Biologie was man nicht in ihre Axiome hineinlegt (ein Schelm wer Böses dabei denkt). Und diese Wissensbereiche sind zu mächtig um sie affirmativ, positiv, d.h. logisch zu fassen. Die Umfirmierung des Positivismus in analytische Philosophie ist nicht ausreichend ein längst totes Konzept wiederzubeleben.

Aber, ohne Logik wäre der Großteil der sogenannten Aufklärung zum Teufel. Und doch wird kein Weg daran vorbeiführen wieder an den Rationalismus anzuschließen, denn der Totengräber der Logik – die Entropie – arbeitet unermüdlich Tag und Nacht.

Lieber Herr Luediger,

zurück aus der Sommerpause wollte ich doch wenigstens Ihren Kommentar nicht ungewürdigt lassen und ein paar Zeilen hinterlassen.

Sie sprechen mir aus der „Seele“. Genau, das war mit meinem Essay zur „Metamathematik“ eigentlich intendiert gewesen, was aber auch scheinbar nicht immer ganz „rüber gekommen“ ist.

„Seit Gödel geistert die formale Logik als Untote durch die Wissenschaft.“ Da muss man noch nicht einmal „Vampirjäger“ sein, um dieses „Schreckgespenst“ bei seinen „nächtlichen Streifzügen“ durch das „Unterholz der Naturwissenschaften“ beobachten zu können.

Der Logizismus eines Freges:

„Alle mathematischen Wahrheiten müssen sich anhand von Definitionen mit strikten Beweisen auf eine fest umgrenzte Anzahl von Axiomen zurückführen lassen.

Bei diesen Axiomen selbst muss es sich um evidente logische Wahrheiten handeln, d. h., sie dürfen nach Freges Worten „eines Beweises weder fähig noch bedürftig“ sein.“ (https://de.wikipedia.org/wiki/Logizismus)

Und das hieran anschließende Hilbert-Programm des Formalismus durch die „Widerspruchsfreiheit“ in der klassischen Mathematik mit Hilfe von „finiten Methoden“ durch die rein formale „Operation mit mathematischen Symbolen“ hatte schon deutliche „Zombie-Merkmale“, da es nur noch „tote Hülle“ ohne irgendeinen „lebendigen Inhalt“ ist.

Okay, da haben Sie natürlich auch Recht: „Aber, ohne Logik wäre der Großteil der sogenannten Aufklärung zum Teufel“. Daher ist der Brouwersche Intuitionismus auch nicht wirklich die „Wiedererweckung von den Toten“. Daher fand ich den Strukturenrealismus ja in dieser Hinsicht auch sehr erfrischend, da er sich mit den obigen Problemen scheinbar nicht herumschlagen muss.

Ihren Gastbeitrag „Skizze eines Negativen Strukturalismus – Eine minimalistische Theorie der Erfahrung“ halte ich insofern für sehr produktiv, da er meines Erachtens eine ähnliche thematische Stoßrichtung hat.

Daher lassen wir der „Entropie“ doch einfach mal ihren Lauf und hoffen, dass wir noch bei Lebzeiten einen Paradigmenwechsel miterleben dürfen.

Viele Grüße

Dirk Boucsein